Desenvolvida por pesquisadores chineses e norte-americanos, IA pode ser usada para gerar legendas

Pesquisadores da empresa chinesa Alibaba, da Universidade de Zhejiang e do Instituto de Tecnologia Stevens, nos Estados Unidos, desenvolveram um sistema que usa tecnologia de reconhecimento facial, inteligência artificial e machine learning para identificar quais palavras foram ditas por alguém em um vídeo. O sistema foi batizado de “Lip by Speech” (LIBS).

Essa não é a primeira vez que pesquisadores desenvolvem sistemas de reconhecimento de palavras em vídeo. Em 2016, um sistema desenvolvido pelo Google em parceria com a Universidade de Oxford era capaz de ler lábios em vídeos, com precisão de acerto em cerca de 46,8%.

De acordo com o Venture Beat, o LIBS consegue extrair informações de grande utilidade e em vários níveis como nível de sequência e nível de contexto. Com essas informações, o sistema alinha esses dados com os dados do vídeo, identificando a correspondência entre eles e, com isso, gera um texto das palavras que foram ditas no vídeo.

Os pesquisadores observam que o modelo demorou para conseguir resultados “razoáveis”. No entanto, após um pré-treinamento com frases de até 16 palavras, a inteligência artificial foi capaz de melhorar sua qualidade de identificação de palavras, otimizando seus resultados, principalmente em nível de contexto.

O LIBS pode ser usado em projetos com objetivo de ajudar aqueles que portam dificuldades auditivas, mas querem consumir conteúdos em vídeo que não foram legendados, como matérias ao vivo, por exemplo. Essa tecnologia pode ser muito eficiente na garantia de acessibilidade das 466 milhões de pessoas no mundo que sofrem de perda auditiva, ou cerca de 5% da população mundial, como informa a Organização Mundial da Saúde (OMS).

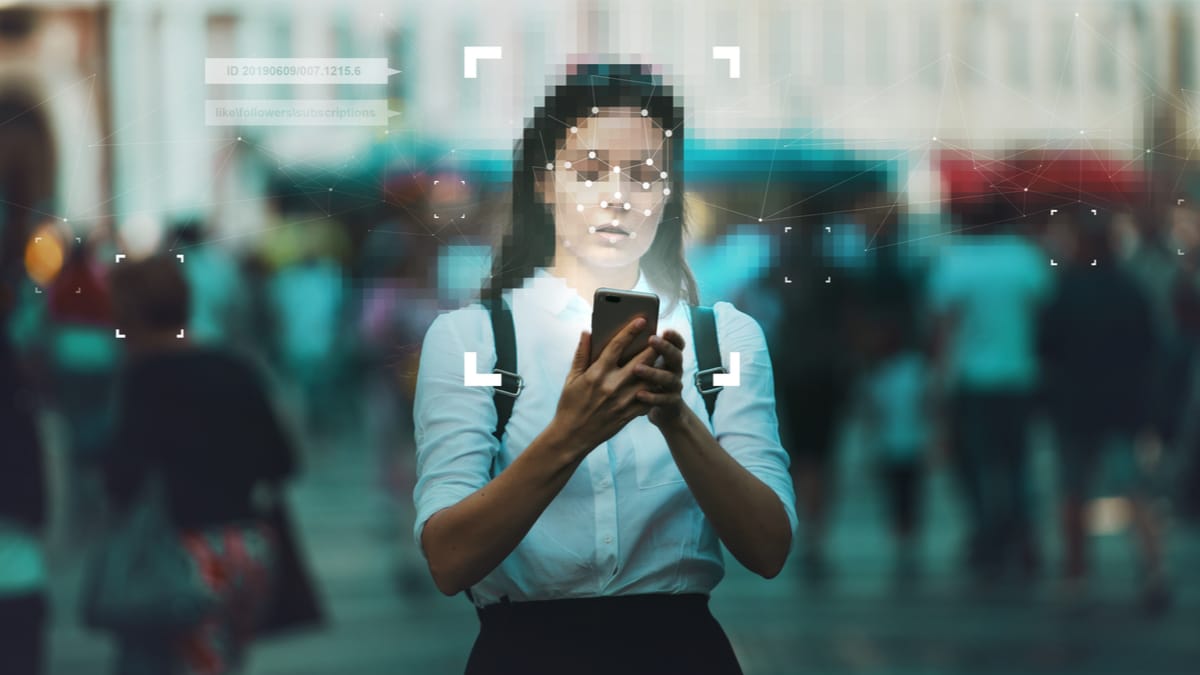

No entanto, vale lembrar que a mesma tecnologia poderia ser usada para fins de vigilância de regimes totalitários, como a China tem empregado o seu sistema de reconhecimento facial em locais públicos como ruas e aeroportos.